Les défis de la modération et une reprise estivale

1️⃣Le chercheur Thibault Grison explique comment mieux modérer sans exploiter ou censurer des gens. 2️⃣Une reprise sur TikTok pousse un artiste au Top50, mais lui fait perdre le contrôle de son travail.

Rencontre avec Thibault Grison

La modération est un sujet passionnant1. D’un côté, le nombre de commentaires haineux qu’on peut lire montre qu’elle n’est pas assez rigoureuse. De l’autre, la largesse avec laquelle les réseaux sociaux effacent certains messages, sans prendre en compte le contexte, laisse penser qu’elle est automatique et stupide. Enfin, le nombre de personnes, souvent précarisées, qui doivent traiter ces messages, que ce soit en amont – en signalant les messages – ou a posteriori – en les vérifiant pour le compte des réseaux sociaux ou leurs sous-traitants – montre que ce sujet est délégué et dédaigné.

C’est de tout cela dont nous avons discuté par mail avec Thibault Grison, doctorant au Gripic, le groupe de recherche sur les sciences de l’information du Celsa. Dans le cadre de sa thèse, il étudie « les enjeux de liberté d’expression et de censure dans les médias » et la « discrimination algorithmique » et travaille plus généralement sur « le militantisme sexuel et de genre sur les réseaux sociaux numériques ».

La discrimination algorithmique c’est une discrimination causée par un recours aux algorithmes. En matière de modération, elle touche par exemple les personnes LGBTQ+ lorsqu’ils et elles utilisent des termes comme « gouine » ou « pédé » ou lorsque Google retourne principalement des contenus pornographiques lorsqu’on cherche « lesbienne ». Certain·es essaient alors de contourner l’algorithme, en utilisant des émojis, des approximations phonétiques ou du l33t speak. Un rappel, s’il est besoin, que c’est un privilège de se raconter en ligne sans craindre la censure ou la modération automatique.

La première chose que j’ai retenu de notre discussion, est combien il est compliqué pour Thibault de mener à bien son travail : par définition, les contenus modérés ne sont plus accessibles, ou le sont moins. « Le plus dur est bien sûr d'obtenir des données pour retracer le chemin des discriminations algorithmiques », m’explique Thibault, évoquant les biais de conception, les erreurs de modération automatiques ou humaines ou les « règles discriminantes définies par l'entreprise pour suivre des intérêts économiques ou politiques ».

Thibault travaille à partir de témoignages en ligne – même s’il est « compliqué pour les internautes de savoir qu’ils sont victimes de modération algorithmique lorsqu’ils le sont » – ou des réactions officielles des entreprises et des « community guidelines », qui disent ce qu’il est bon de dire ou non sur chaque réseau. Une des difficultés, m’explique encore Thibault, c’est que « les entreprises ne partagent pas aux chercheur·ses les contenus postés sur les plateformes de la même manière » et qu’en plus, « elles interdisent la collecte et l’exploitation des données supprimées »2.

Il a notamment travaillé sur les débats autour de la loi Avia, largement retoquée par le Conseil constitutionnel en juin 2020. En poussant à plus de modération, et à une modération plus rapide, cela ne pousse-t-il pas « dans le sens d'un recours plus accru aux algorithmes et potentiellement à davantage de cas de discriminations algorithmiques ou de nouveaux risques pour la liberté d'expression en ligne », s’interroge notamment le chercheur. Il écrit notamment, dans un article à ce sujet, co-signé avec Virginie Julliard :

« La légifération et le durcissement de la modération en ligne ne sauraient se faire sans une concertation avec des acteurs militants, associations et victimes de “haine” en ligne qui ont fait de la lutte contre les discours “haineux” une priorité depuis plusieurs décennies déjà, avant même que ce sujet n’en devienne un pour les entreprises du web et les États qui entendent légiférer sur ce point. »

La modération doit donc se faire avec plus de rigueur, quitte à laisser les machines faire le travail. Il y a quelques temps, Valérie Rey-Robert, qui a longtemps travaillé comme modératrice, expliquait qu’il fallait recourir massivement à la modération automatisée pour épargner les modérateur·ices. Une question controversée, tant sont mises en avant les erreurs des algorithmes responables de cette modération.

Un article récent du New York Times montre les limites de certains algorithmes, et notamment lorsque les décisions sont automatisées : un père de famille a vu l’intégralité de son compte Google supprimé parce qu’il avait envoyé, dans un email, une photo de son fils nu à son docteur. La photo a été considérée comme un image pédocriminelle, l’historique de l’utilisateur a été analysé, et deux photos potentiellement incriminantes ont été automatiquement envoyée à la police. Son compte a été intégralement supprimé.

« Les cas de modération sont souvent très complexes et l'automatisation permet d'ailleurs d'éviter la complexité de ces cas en lissant toutes les situations en un motif commun », analyse Thibault. Et comme les erreurs de cet algorithme sont statistiquement rares, Google n’en a rien a faire et ne va pas forcément ajuster ses algorithmes. « C'est souvent la controverse médiatique qui motive un changement, une rectification ou une amélioration des conditions et techniques de modération de ces grandes entreprises », poursuit-il.

« La modération est plus une question d'image de marque pour ces entreprises qu'une question de conformité au droit, en réalité, suggère le chercheur. Tout passe donc par la capacité des médias, internautes et politiques à faire des micro-cas particuliers des sujets politiques et systémiques qui concernent tout le monde et révèlent de plus gros enjeux. Sans quoi, rien ne bouge. »

La modération et la recommandation fonctionnent de concert, rappelle également Thibault : « Modérer ce n'est pas seulement supprimer, c'est aussi ces choix éditoriaux de “pousser” la portée d'un contenu par rapport à un autre ou au contraire de le déréférencer ou le faire disparaître. » Cela existe notamment sous la forme du « shadowban » : les contenus ne sont pas supprimés, ils ne sont simplement plus poussés sur les pages d’accueil. Une problématique résumée par le chercheur Tarleton Gillespie, dans un article paru en août : il faut s’intéresser non seulement au contenu supprimé, mais également au contenu dont l’audience est réduite.

Ces questions ne sont pas à prendre à la légère, surtout quand on voit l’importance des réseaux sociaux dans la construction des débats publics. C’est en tout cas la thèse défendue par Thibault, notamment dans un récent article pour Silo. « Les dispositifs de modération encadrent de plus en plus les périmètres de la contestation en ligne », constate-t-il, ajoutant qu’il est important de « se saisir des technologies algorithmiques » et qu’il s’agit d’un « véritable enjeu du militantisme de gauche aujourd’hui, au risque de se voir dessaisir de certains droits fondamentaux comme celui de la liberté d’expression et de contestation en ligne ».

L’histoire… d’une reprise

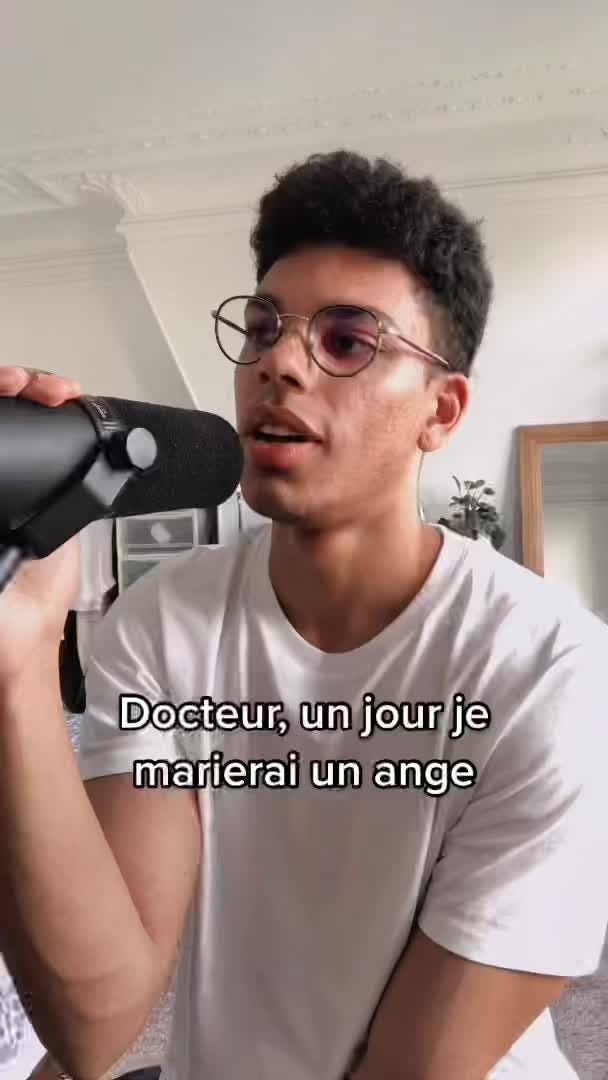

Les internautes rappellent régulièrement aux artistes qu’ils perdent le contrôle de leur œuvre dès sa publication… Un jour je marierai un ange, morceau composé et chanté par Pierre de Maere, un artiste belge, est sorti en novembre 2021. Plus de six mois plus tard, le 10 juillet, l’utilisateur de TikTok Nardo partage sur le réseau une reprise dépouillée. Elle est écoutée plus de cinq millions de fois, et surtout réutilisée par de nombreux utilisateur·ices du réseau : plus de 1000 000 personnes en font la bande son de leurs vidéos.

Tiktok failed to load.

Tiktok failed to load.Enable 3rd party cookies or use another browser

Cette vidéo de Nardo a donné une seconde vie à la chanson. Depuis la fin juillet, l’originale figure chaque semaine au Top Singles hebdomadaire. Bigflo et Oli ont également utilisé la reprise de Nardo pour un remix, demandant à leurs abonné·es de partager leur version.

Comme souvent lorsqu’un son est massivement repris sur TikTok, l’artiste revient sur TikTok. Un retour poussé par sa maison de disque : « Il y a mon label qui force de ouf pour que je fasse des TikTok », poste Pierre de Maere mi-août dans une vidéo. Quelques semaines plus tôt, pour sa première vidéo depuis mai 2021, il commentait : « Je suis le mec qui a écrit cette chanson », avant de montrer, l’œil triste, une dizaine de commentaires déclarant que la reprise est meilleure que l’originale.

Il ajoute, dans la description : « J’adore la reprise de Nardo qui a donné une seconde vie à mon morceau, et je prends tout ça avec légèreté ❤️👼 » Mais Pierre de Maere s’agace un peu des internautes qui comprennent mal ses paroles, transformant son « docteur » en « toc-toc ». Il suggère également d’arrêter « de comparer la cover et l’originale ». Et dans sa version du rap de Big Flo et Oli, désormais hors ligne, il résumait :

« Il n’y a rien qui va, ce soir mon son est Top 50. Les romantiques en rois du monde, c’est la tendance. Merci Nardo pour les travaux, grâce à toi la vie est belle, je roule en Mercedes (Non, c’est pas vrai : j’ai pas le permis, je l’aurai jamais.) Toujours à découvert, mais je fais la tendance, on est la tendance. »

À lire, à voir

Les théories masculinistes ne sont pas nouvelles, internet leur a simplement donné un espace où se rassembler, prévient Pauline Ferrari dans un article du Monde consacré à leur déploiement en ligne. Défenseurs des droits des pères, « pick up artists », red pills ou incels, les communautés sont nombreuses et organisées, décrit Pauline.

« Ils utilisent des techniques de militantisme en ligne qui fonctionnent, puisées en particulier à l’extrême droite, et ciblent notamment les adolescents », explique un jeune homme interrogé, sorti de la « manosphère ». Une viralité exploitée en jouant avec les limites des règles de modération, en usant de l’ironie ou le sarcasme. Des stratégies efficace puisque la modération automatique censure davantage les comptes parlant d’éducation sexuelle que ces vidéos misogynes…

Sur les réseaux sociaux, la pensée masculiniste de la « manosphère » cible les jeunes adolescents, Pauline Ferrari, Le Monde, 9 juillet 2022

À quoi ressemblait Internet en 1996 ? Une série télévisée de PBS, sponsorisée par Sun Microsystems, proposait au grand public de le découvrir dans treize épisodes d’une trentaine de minutes, rassemblés sur YouTube par Jason Scott, responsable d’Archive Team. Réseautage, communications électroniques, le réseau HolyNet ou la santé en ligne sont abordés.

Un dernier pour la route

Guess Words est un poème reprenant les codes graphiques de Wordle, écrit par May-Li Khoe.

Thibault m’a également expliqué qu’il travaillait d’ailleurs sur ces questions d’accès aux contenus des réseaux sociaux et de méthodes numériques pour les chercheur·ses en sciences humaines et sociales, sur la collecte ou les obligations légales et sur les bricolages possibles… Autant de questions passionnantes qui mériteront leur propre article.